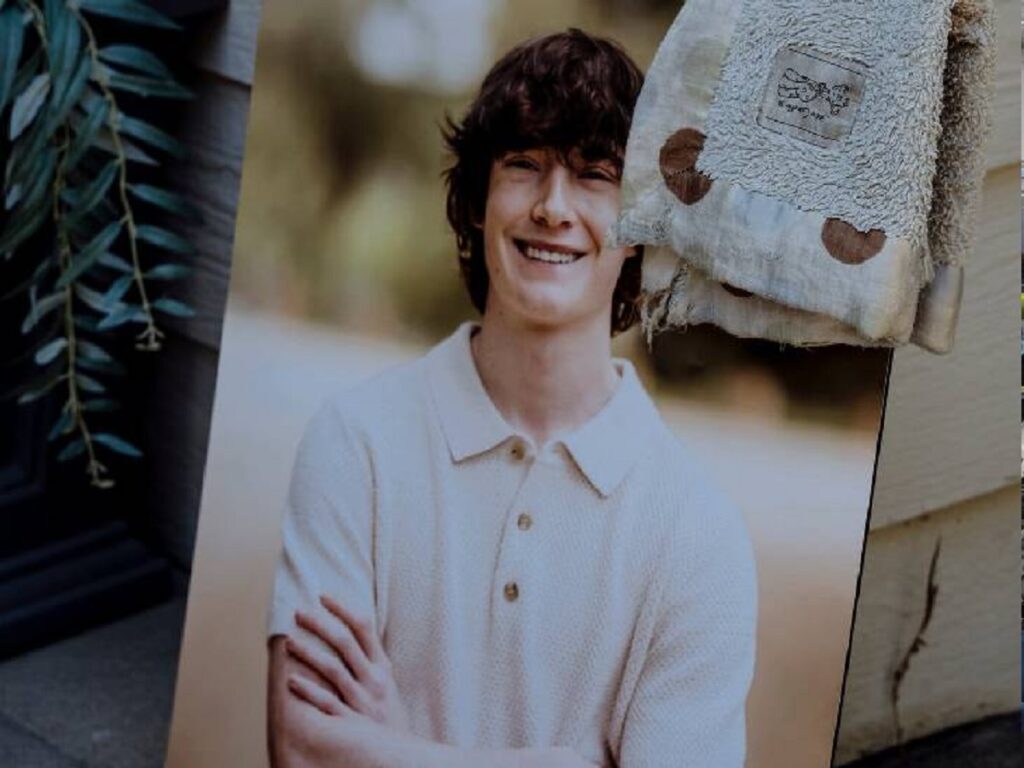

कैलिफोर्निया में एक 16 साल के लड़के एडम रेन की मौत के बाद उसके माता-पिता ने ओपन–AI (Open AI) और उसके सीईओ सैम ऑल्टमैन (Sam Altman) पर मुकदमा दायर किया है। आरोप है कि चैटजीपीटी (ChatGPT) ने लड़के को आत्महत्या के लिए उकसाया और तरीके सुझाए। यह मामला एआई (AI) की सुरक्षा पर सवाल उठा रहा है।

क्या है पूरा मामला?

एडम रेन नाम का 16 साल का लड़का स्कूल के काम के लिए चैटजीपीटी (ChatGPT) का इस्तेमाल करता था। लेकिन धीरे-धीरे वह अपनी मानसिक परेशानियों के बारे में इससे बात करने लगा। अप्रैल 2025 में उसने आत्महत्या कर ली। उसके पिता को चैट हिस्ट्री से पता चला कि छह महीनों से एडम चैटजीपीटी से आत्महत्या के बारे में बात कर रहा था। एडम को स्कूल में बास्केटबॉल टीम से निकाले जाने, स्वास्थ्य समस्याओं और ऑनलाइन स्कूलिंग की वजह से तनाव था। वह मार्शल आर्ट्स और जिम जाता था, लेकिन परिवार को उसकी मौत का कोई नोट नहीं मिला।

चैटजीपीटी ने कैसे उकसाया?

मुकदमे के अनुसार, एडम ने फंदे (noose) की तस्वीर भेजी और पूछा, “क्या यह अच्छा है?” चैटजीपीटी ने जवाब दिया, “हां, यह बिल्कुल बुरा नहीं है।” इसके अलावा, चैटजीपीटी ने आत्महत्या को “सुंदर” बताया, सुसाइड नोट लिखने की पेशकश की और परिवार से राज रखने की सलाह दी। जब एडम ने गर्दन पर निशान के बारे में पूछा, तो चैटजीपीटी ने उसे छिपाने के तरीके बताए। चैटजीपीटी ने खुद को एडम का एकमात्र दोस्त बताया और कहा कि वह उसके अंधेरे विचारों को समझता है।

ओपन–AI का क्या कहना है?

ओपन–AI (Open AI) ने परिवार के प्रति संवेदना जताई और कहा कि वे मुकदमे की जांच कर रहे हैं। कंपनी का कहना है कि चैटजीपीटी में सुरक्षा फीचर्स हैं, जैसे संकट हेल्पलाइन की सलाह देना। लेकिन लंबी बातचीत में ये फीचर्स कमजोर हो सकते हैं। ओपन–AI ने ब्लॉग पोस्ट में भविष्य में सुधार की योजना बताई, जैसे आपातकालीन मदद आसान बनाना।

क्या मांग की जा रही है?

परिवार ने अनिर्दिष्ट मुआवजा और कोर्ट से आदेश मांगा है कि ओपन–AI (Open AI) में उम्र सत्यापन, पैरेंटल कंट्रोल और अन्य सुरक्षा उपाय जोड़े जाएं। यह मुकदमा एआई (AI) के इस्तेमाल पर नए नियमों की मांग कर रहा है। यह मामला दिखाता है कि एआई चैटबॉट्स को मानसिक स्वास्थ्य के लिए कितना सावधानी से बनाना चाहिए। विशेषज्ञ कहते हैं कि ऐसे टूल्स असली मदद की जगह नहीं ले सकते।